AnimateLCMの仕組みと特徴を徹底解説!次世代動画生成AIの革新技術

ビデオ生成技術は、エンターテイメントから教育まで、さまざまな分野で革新的な応用が期待されています。しかし、高品質なビデオを生成するための技術は、計算負荷が高く、時間がかかるという課題がありました。そこで登場したのが、AnimateLCMというツールです。このツールは、事前学習された画像拡散モデルを蒸留してサンプリングを最小のステップで加速する一貫性モデル(CM)と、条件付き画像生成におけるその成功した拡張である潜在一貫性モデル(LCM)に触発されて提案されました。これにより、最小のステップで高忠実度のビデオ生成が可能になり、ビデオ生成技術の新たな可能性を開くことが期待されています。

- プロンプトの送信回数:6回

- 使用したモデル:Microsoft Copilot、ChatGPT、GPTs

- Microsoft Copilotは旧Bing Chatのことを指し、Microsoft Copilot for Microsoft 365とは異なります。

AIとデジタルイノベーションでビジネスを変える時が来ました。

私たちと一緒に、効果的なマーケティングとDXの実現を目指しませんか?

弊社では、生成AI開発やバーチャルインフルエンサーの運用について無料相談を承っております。

お打ち合わせではなくチャットでのご相談もお待ちしております。

目次

Animate LCMとは?

Animate LCMについての詳細情報

Animate LCMについて試す方法

人間の担当者が試してみた

AIによるまとめ

この記事は、AI(人工知能)によって生成されたものです。

内容は専門家による監修や校正を経ておらず、AIの現在の能力と知識ベースに基づいています。

したがって、記事の内容には限界があり、専門的な意見や最新の情報を代替するものではありません。

読者は、この記事を参考の一つとして用いることを推奨し、必要に応じて専門家の意見を求めることをお勧めします。

以下から、AIライターの執筆が始まります。

Animate LCMとは?

AnimateLCMは、ビデオ拡散モデルのアニメーションを高速化するためのツールです。

ビデオ拡散モデルは、一貫性と高い忠実度を持つビデオを生成する能力で注目を集めていますが、反復的なノイズ除去プロセスにより計算が集中し、時間がかかるため、その応用が制限されています。

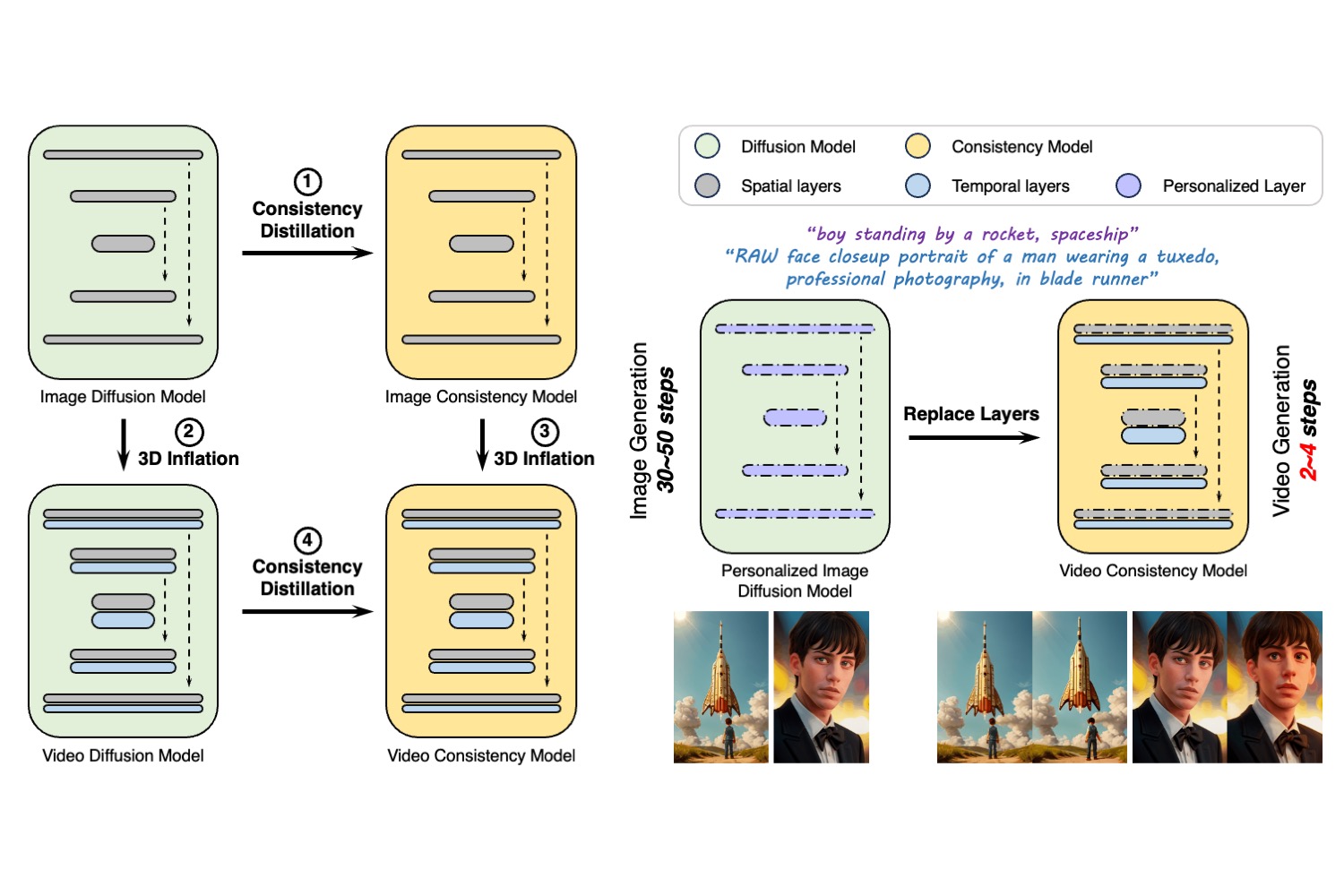

これに対して、AnimateLCMは、事前学習された画像拡散モデルを蒸留してサンプリングを最小のステップで加速する一貫性モデル(CM)と、条件付き画像生成におけるその成功した拡張である潜在一貫性モデル(LCM)に触発されて提案されました。これにより、最小のステップで高忠実度のビデオ生成が可能になります。

生成されたアニメーションの一つ

Animate LCMについての詳細情報

1 高速なビデオ生成

先ほどご紹介したように、AnimateLCMは、事前学習された画像拡散モデルを蒸留してサンプリングを最小のステップで加速する一貫性モデル(CM)と、条件付き画像生成におけるその成功した拡張である潜在一貫性モデル(LCM)に触発されて提案されました。これにより、最小のステップで高忠実度のビデオ生成が可能になります。

2 画像生成と動き生成の蒸留の分離

AnimateLCMは、画像生成の事前知識と動き生成の事前知識の蒸留を分離することで、一貫性学習を行います。これにより、訓練効率が向上し、生成視覚品質が向上します。

リアリスティックな動画

3 プラグアンドプレイアダプターの組み合わせ

AnimateLCMは、既存のアダプターを我々の蒸留されたテキスト条件付きビデオ一貫性モデルに適応させる、またはサンプリング速度を損なうことなくゼロからアダプターを訓練する効率的な戦略を提案します。

これにより、さまざまな機能(例えば、制御可能な生成のためのControlNet)を達成するためのプラグアンドプレイアダプターの組み合わせが可能になります。

4 多様なスタイルのアニメーション生成

AnimateLCMは、現実的なアニメーション、アニメ、3Dカートゥーンなど、さまざまなスタイルのアニメーションを生成することができます。

まさかの可愛すぎる子猫まで登場

これらの特性により、AnimateLCMは、ビデオ生成の新たな可能性を開くとともに、ビデオコンテンツの生成と編集、エンターテイメント、教育、広告など、さまざまな分野での応用が期待されています。

Animate LCMについて試す方法

AnimateLCMのGitHubレポジトリとHugging Faceのページには、詳細なガイドが提供されていますが、英語で書かれているため理解が難しい場合があります。

以下に、これらのリソースから得られる主な情報を日本語で簡単に説明します。

1 インストール方法

AnimateLCMのコードはGitHubにホストされています。通常、GitHubのプロジェクトは、プロジェクトのルートディレクトリにあるREADME.mdファイルにインストール手順が記載されています。このファイルを開き、指示に従って必要なソフトウェアやライブラリをインストールします。

2 モデルの実行手順

モデルの実行手順も通常はREADME.mdファイルに記載されています。具体的なコマンドラインの例や、必要な引数やパラメータの説明が含まれていることが多いです。

3 デモの利用方法

Hugging Faceのページには、AnimateLCMのデモが提供されていることがあります。これらのデモは、ウェブブラウザ上で直接モデルを試すことができるインタラクティブな環境を提供します。デモのページには通常、デモの使い方や、モデルに入力できるデータの種類や形式についての説明が含まれています。

人間の担当者が試してみた

今日も今日とて人間の担当者も試してみます。

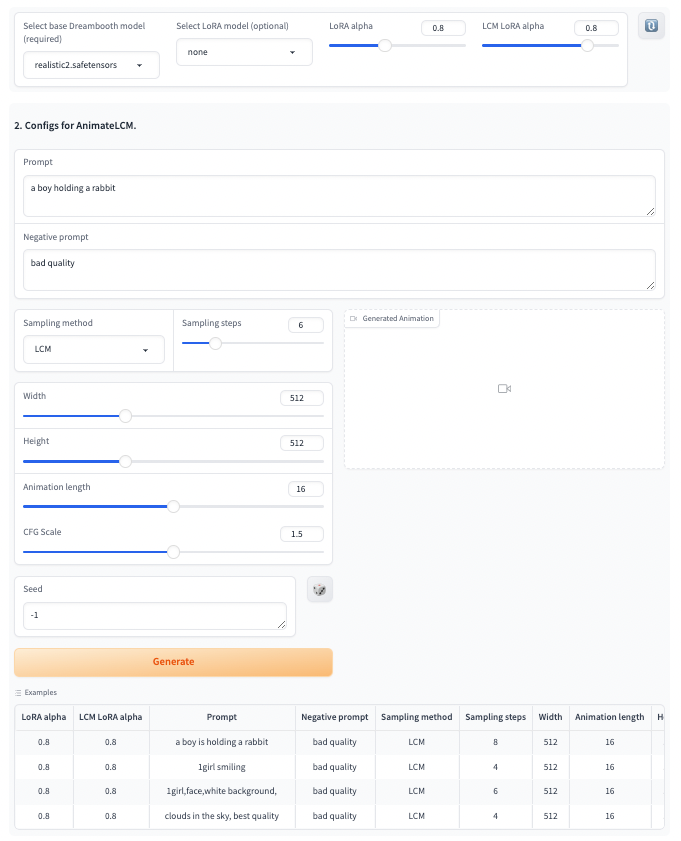

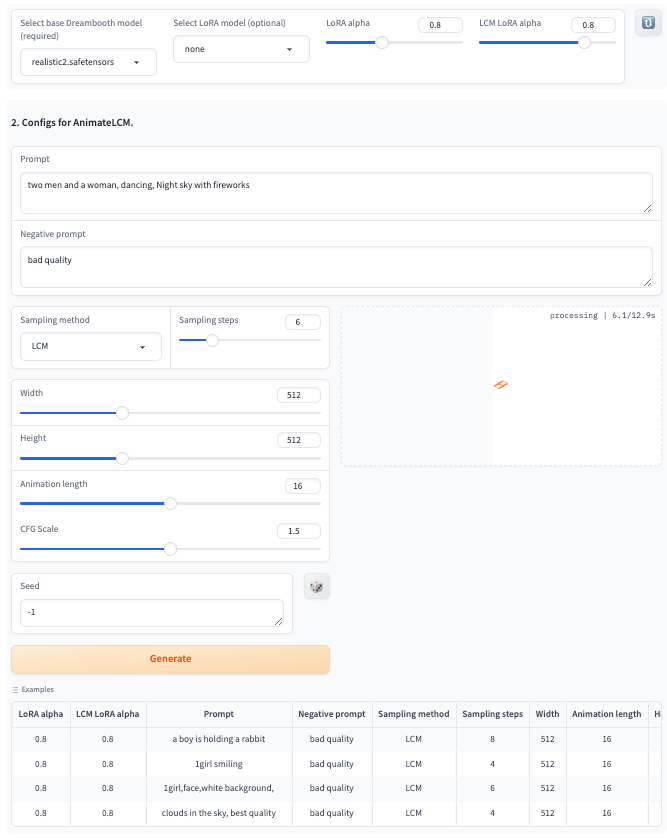

すでに設定されている設定画面を用いて生成してみます。

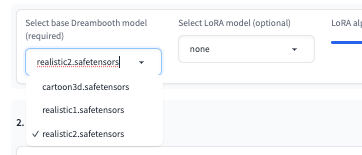

現状、 Dreambooth modelは公式ページに掲載されていた内容から3種選択が可能です。LoRAやSampling methodに関してはすでに設定されている内容での対応でした。

あとはプロンプトを入力して動画生成を待機してみます。

従来の動画生成だったら一旦待機して待ってみるか〜の時間です。この表示されている待機時間はあくまで予測だろうとしていました。

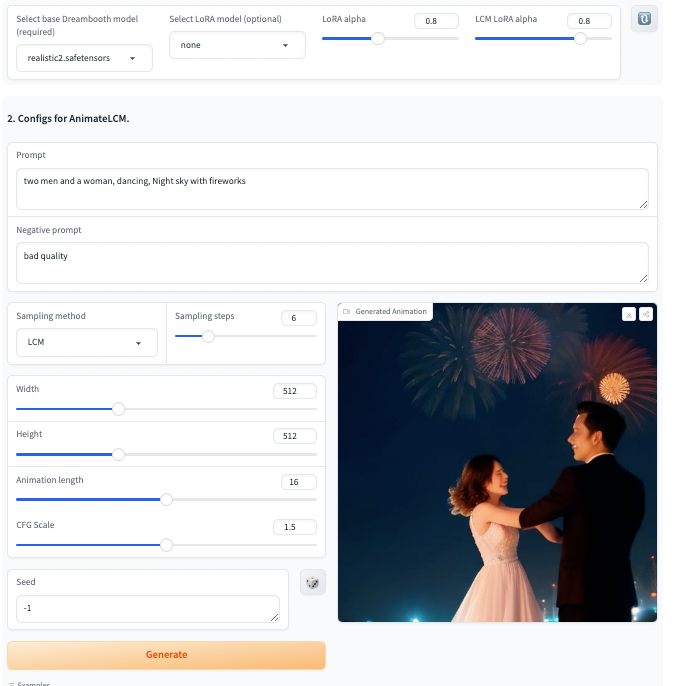

本当に高速生成!?

本当に生成されてしまってその革新性を体感せざるを得ない担当者です。

しかも動画のサムネイルも不気味な感じではなさそうなので、視聴が楽しみです。早速見てみましょう。

超高速ドレス着替えチャレンジがあったが、花火のクオリティは高い!

実際に夜空に花火が上がっているし、二人の人間(真偽不明)がダンスしている動画が登場しました!これはすごいです...早く色々と試してみたいですね。

みなさんもこちらから試してみてください。

AIによるまとめ

AnimateLCMは、ビデオ生成技術の新たな可能性を開くツールとして注目を集めています。その高速なビデオ生成能力と、画像生成と動き生成の蒸留を分離することで一貫性学習を行う独自のアプローチにより、訓練効率が向上し、生成視覚品質が向上します。

また、既存のアダプターを蒸留されたテキスト条件付きビデオ一貫性モデルに適応させる効率的な戦略を提案し、さまざまな機能を達成するためのプラグアンドプレイアダプターの組み合わせが可能になります。

これらの特性により、AnimateLCMは、科学研究から金融分析まで、さまざまな領域で急速な進歩を達成するための重要なツールとなり、大規模なデータから迅速に有意義な洞察を導き出す能力は、多くの分野での革新と発見を加速することが期待されています。

ちなみに余談ですが、Copilotの「厳格モード」はとても真面目で、そしてどこかに野望を感じられるような文章を生成してくれます。

最後に

弊社では、AIを活用したマーケティングやDXのご相談を承っておりますので、ご興味がある方はぜひご連絡ください。

公式LINEでも随時、生成AIのトレンドや活用方法について発信しています。